L’intelligence artificielle générative (IA générative) est une technologie qui permet de créer du contenu original — texte, images, musique, vidéo, code — à partir de données existantes. Contrairement aux systèmes d’IA traditionnels conçus pour reconnaître, classer ou prédire, l’IA générative produit du nouveau.

Aujourd’hui, elle est partout : ChatGPT rédige vos e‑mails, Midjourney illustre vos présentations, GitHub Copilot suggère des lignes de code, Suno compose une musique sur mesure. Cette révolution change la façon dont nous travaillons, créons et apprenons.

Ce guide a pour objectif de vous expliquer en termes simples ce qu’est l’IA générative, comment elle fonctionne, ses applications concrètes, ses limites et les perspectives à venir. Vous n’avez besoin d’aucune connaissance technique pour le lire.

1. IA générative vs IA discriminative : quelle différence ?

Pour bien comprendre l’IA générative, il faut la comparer à l’IA discriminative (ou analytique).

IA discriminative :

- Objectif : classer, identifier, prédire.

- Question typique : « Qu’est‑ce que c’est ? »

- Exemples : reconnaissance faciale (iPhone), détection de spam, diagnostic médical à partir d’une radio, recommandation de produits (Amazon).

IA générative :

- Objectif : créer, imaginer, synthétiser.

- Question typique : « Qu’est‑ce qui pourrait être ? »

- Exemples : génération d’un article de blog, création d’une image à partir d’une description, composition d’une mélodie, écriture d’un script vidéo.

En résumé :

- L’IA discriminative analyse le monde.

- L’IA générative simule le monde.

Une analogie simple : l’IA discriminative est comme un critique d’art qui identifie le style d’un tableau ; l’IA générative est le peintre qui produit une nouvelle toile.

2. Comment fonctionne l’IA générative ?

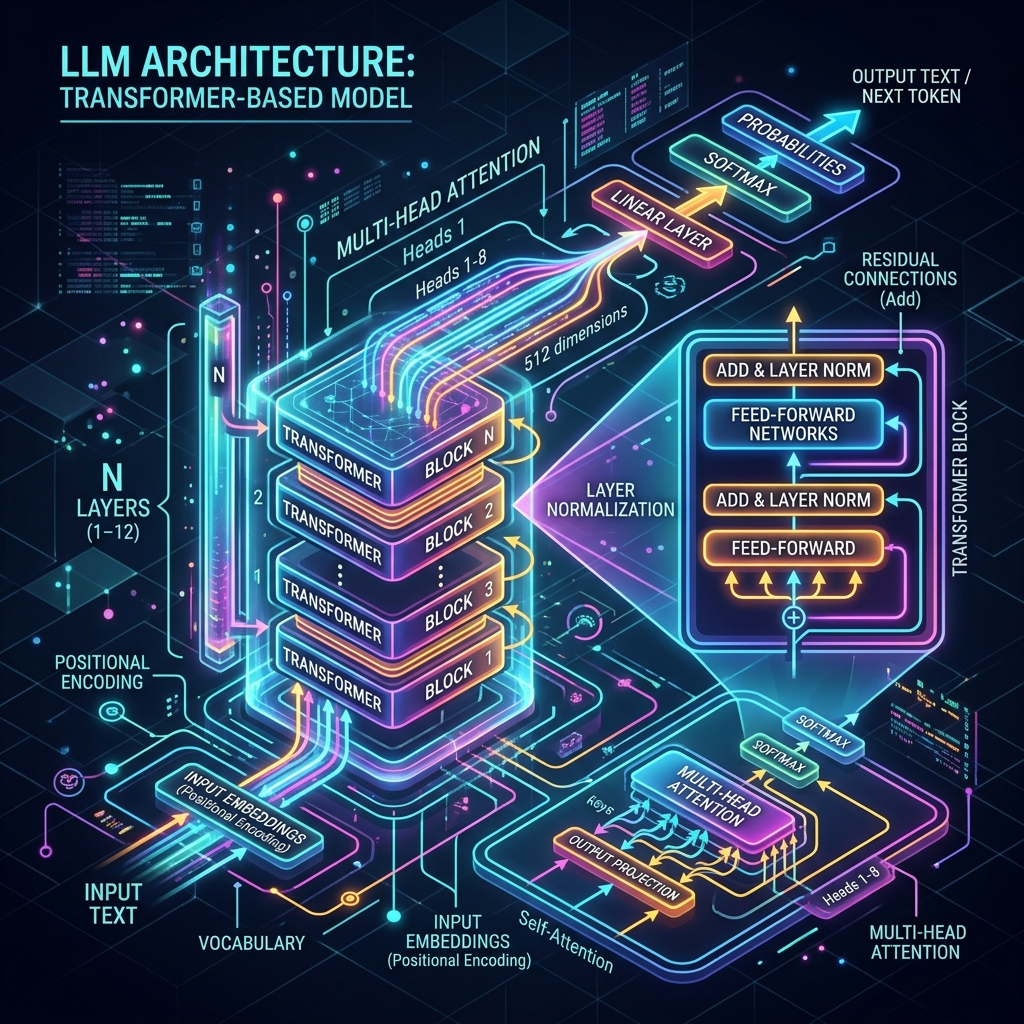

Deux familles d’architectures dominent aujourd’hui : les modèles de langue (LLM) et les modèles de diffusion. Derrière chacune se cachent des concepts mathématiques complexes, mais nous allons les expliquer simplement.

2.1 Les LLM (Large Language Models)

Les LLM — GPT‑4, Claude, Llama, Gemini — sont entraînés sur des milliards de phrases provenant d’Internet, de livres, d’articles scientifiques. Leur objectif initial est de prédire le mot suivant dans une séquence.

Comment ça marche ?

- Le modèle lit une phrase tokenisée (découpée en mots ou sous‑mots).

- Il calcule, pour chaque position, une probabilité pour le token suivant.

- Il choisit le token le plus probable (ou un token aléatoire pondéré) et l’ajoute à la séquence.

- Il répète jusqu’à obtenir un texte de la longueur souhaitée.

L’innovation clé : le Transformer, un mécanisme d’attention qui permet au modèle de pondérer l’importance de chaque mot dans la phrase, même s’ils sont éloignés. Cela lui donne une compréhension contextuelle fine.

Exemple : pour compléter « Le chat est assis sur le […] », le modèle a appris que « tapis », « canapé », « bureau » sont des suites plausibles. Il choisit en fonction du contexte précédent.

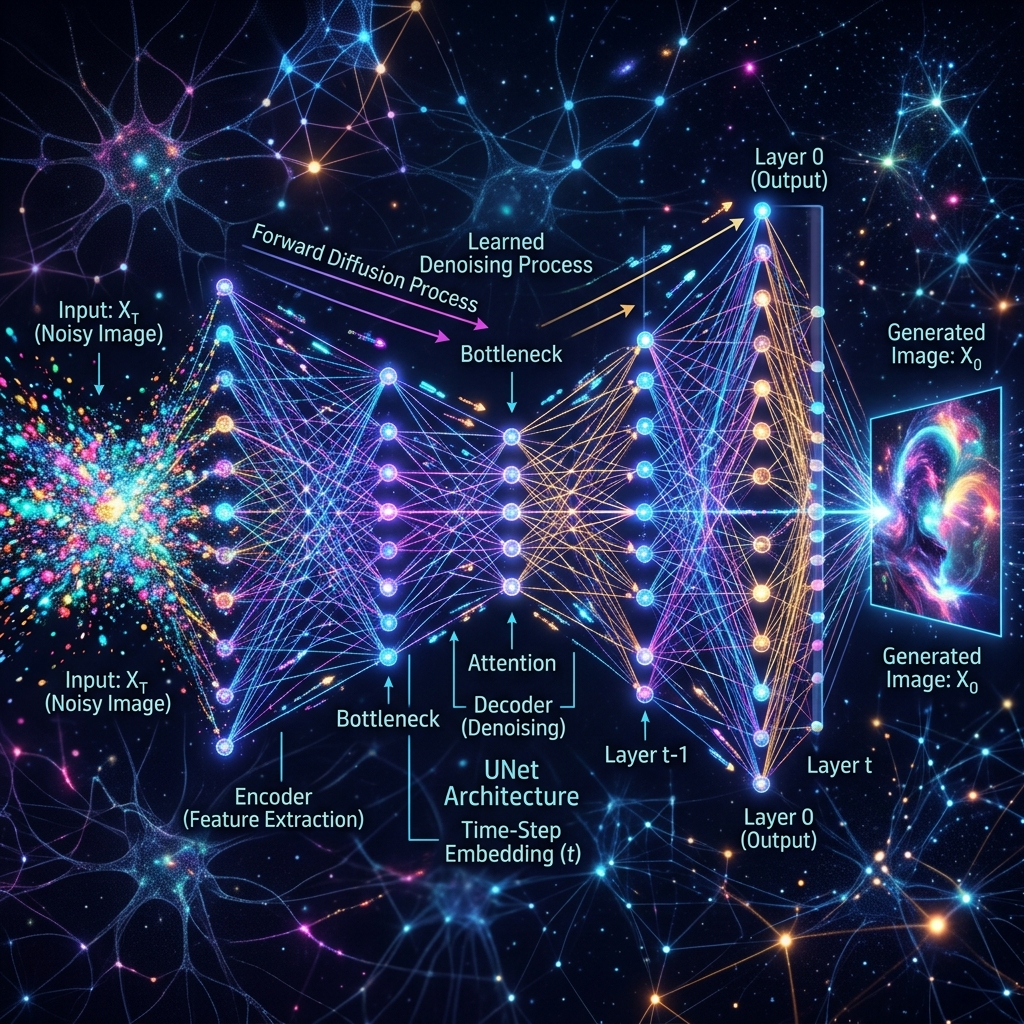

2.2 Les modèles de diffusion

Principalement utilisés pour la génération d’images (DALL‑E, Stable Diffusion, Midjourney), les modèles de diffusion fonctionnent par ajout puis suppression de bruit.

Processus en deux étapes :

Phase d’entraînement (forward diffusion) :

- On prend une image réelle.

- On ajoute progressivement du bruit gaussien, jusqu’à ce que l’image ne soit plus qu’un bruit aléatoire.

- Le réseau apprend à prédire le bruit ajouté à chaque étape.

Phase de génération (reverse diffusion) :

- On part d’un bruit aléatoire.

- Le réseau, guidé par une description textuelle (prompt), retire peu à peu le bruit pour faire émerger une image cohérente.

- Après quelques dizaines d’itérations, on obtient une image correspondant au prompt.

Ces modèles reposent sur des réseaux de neurones convolutifs ou des Transformers visuels (comme dans Stable Diffusion XL).

2.3 Autres architectures historiques

Avant les LLM et la diffusion, d’autres approches ont émergé :

- GAN (Generative Adversarial Networks) : deux réseaux s’affrontent — un générateur crée de fausses images, un discriminateur tente de les distinguer des vraies. L’adversariale améliore la qualité.

- VAE (Variational Auto‑Encoders) : compriment l’image en un vecteur latent, puis le décompressent pour générer de nouvelles variations.

Aujourd’hui, les LLM et la diffusion ont largement supplanté ces techniques pour la qualité et la stabilité.

3. Exemples concrets d’IA générative

Voici une liste des outils les plus populaires, classés par type de contenu.

- Texte : ChatGPT (OpenAI), Claude (Anthropic), Gemini (Google), Perplexity.

- Images : Midjourney, DALL‑E 3, Stable Diffusion, Adobe Firefly.

- Code : GitHub Copilot, Cursor, Tabnine.

- Audio : Suno, Udio, ElevenLabs.

- Vidéo : Runway, Pika, Sora (OpenAI, non publié).

4. Applications pratiques

L’IA générative n’est pas qu’un gadget ; elle transforme déjà des métiers entiers.

4.1 Création de contenu

- Rédaction : articles de blog, newsletters, posts sociaux, scripts vidéo.

- Illustration : images uniques pour sites web, présentations, livres.

- Vidéo : tutoriels animés, publicités courtes, capsules éducatives.

- Audio : podcasts synthétisés, jingles, fonds sonores.

4.2 Développement logiciel

- Génération de code : fonctions, classes, tests unitaires, documentation.

- Refactoring : amélioration de la lisibilité, optimisation des performances.

- Debugging : explication d’erreurs, suggestions de correctifs.

- Traduction de code d’un langage à un autre.

4.3 Design & marketing

- Maquettes : wireframes, prototypes interactifs.

- Logos & identité visuelle : génération de plusieurs propositions.

- Campagnes publicitaires : textes, visuels, ciblage personnalisé.

- Produits personnalisés : impressions sur demande, design génératif.

4.4 Éducation & formation

- Exercices sur mesure : génération de problèmes adaptés au niveau.

- Corrections automatiques : feedback détaillé sur des dissertations.

- Simulations : dialogues avec des personnages historiques, entraînement à l’entretien.

- Traduction de supports pédagogiques.

4.5 Recherche & innovation

- Synthèse de littérature : résumé d’articles académiques.

- Hypothèses : suggestion de nouvelles expériences, de pistes de recherche.

- Rédaction de papiers, de rapports, de demandes de financement.

5. Limites et risques

L’IA générative n’est pas parfaite. Voici ses principales limites et les risques associés.

5.1 Hallucinations

Les LLM inventent parfois des faits, des citations, des références qui n’existent pas. Il faut toujours vérifier les informations, surtout dans un contexte professionnel ou scientifique.

5.2 Biais

Les modèles reproduisent les biais présents dans les données d’entraînement : stéréotypes de genre, ethniques, culturels, socio‑économiques. Une vigilance critique est nécessaire.

5.3 Deepfakes & désinformation

La facilité à créer des vidéos, audio ou images trompeurs ouvre la porte à la manipulation, à l’usurpation d’identité, à la propagande. Des cadres légaux et techniques se mettent en place pour lutter contre ces dérives.

5.4 Coût environnemental

L’entraînement des grands modèles consomme énormément d’énergie et d’eau. L’inférence (utilisation au quotidien) a aussi un impact, bien que moindre. Les acteurs du secteur cherchent à améliorer l’efficacité énergétique.

5.5 Dépendance & perte de compétences

Trop s’appuyer sur l’IA peut affaiblir la créativité, l’esprit critique, la maîtrise technique. L’objectif est de l’utiliser comme un amplificateur, pas comme un substitut.

5.6 Problèmes juridiques

- Droit d’auteur : les modèles sont entraînés sur des œuvres protégées sans toujours avoir de licence explicite.

- Responsabilité : qui est responsable si un contenu généré cause un préjudice ?

- Vie privée : les données personnelles peuvent fuiter dans les réponses.

6. Notre avis

L’IA générative est une rupture technologique majeure, comparable à l’arrivée d’Internet ou du smartphone. Elle démocratise la création et accélère l’innovation dans tous les secteurs.

Cependant, elle n’est pas magique : c’est un outil, dont la qualité dépend de la qualité des données et des prompts. Les meilleurs résultats viennent d’une collaboration homme‑machine — où l’humain guide, corrige, valide.

À court terme, l’IA générative va continuer à s’améliorer, devenir moins chère, plus intégrée dans nos outils quotidiens. Les métiers vont évoluer, mais l’intelligence humaine restera indispensable pour donner du sens, de l’éthique et de la stratégie.

Notre conseil :

- Expérimentez dès maintenant avec ces outils.

- Formez‑vous aux bonnes pratiques (rédaction de prompts, évaluation des sorties).

- Gardez un esprit critique : vérifiez, recoupez, challengez.

- Soyez transparent sur l’usage de l’IA dans vos productions.

L’IA générative est une opportunité, pas une menace, à condition de l’utiliser avec lucidité.

7. Sources & liens pour aller plus loin

Sources externes

- Intelligence artificielle générative — Wikipédia

- What is generative AI? — MIT Technology Review

- Generative AI: A Creative New World — Sequoia Capital

- The Batch – DeepLearning.AI (newsletter technique)

Vidéos recommandées

Liens internes (sur formation‑en‑ia.fr)

- Comment Rédiger des Prompts efficaces pour ChatGPT ?

- Top 5 des Générateurs IA de Musique en 2025

- Les 7 types d’intelligence artificielle

Article rédigé par l’équipe de Formation‑en‑IA.fr. Dernière mise à jour : avril 2026.